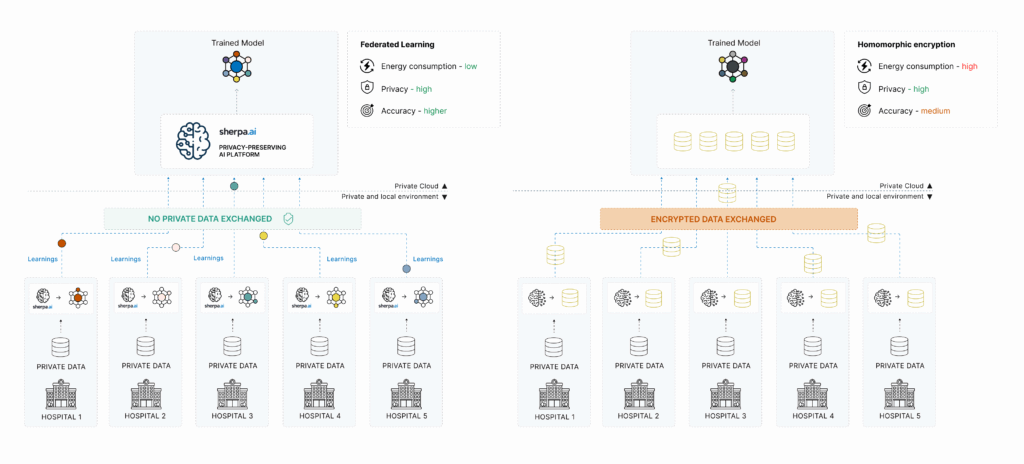

En un entorno donde la privacidad es más importante que nunca, proteger los datos sin renunciar al poder de la inteligencia artificial se ha convertido en una prioridad. Para abordar este reto, han surgido diversas técnicas de privacy-preserving AI. Entre ellas, el Aprendizaje Federado y el Cifrado Homomórfico son dos de las más relevantes.

Ambas permiten entrenar modelos sin acceder directamente a los datos originales. Sin embargo, sus enfoques, niveles de madurez y aplicabilidad en el mundo real son muy diferentes. En este artículo analizamos sus diferencias y explicamos por qué el Aprendizaje Federado, y en particular nuestra plataforma se está consolidando como la solución más eficaz y escalable.

¿Qué es el cifrado homomórfico?

El Cifrado Homomórfico es una técnica criptográfica que permite realizar operaciones sobre datos cifrados sin necesidad de descifrarlos. Es una solución elegante desde el punto de vista teórico, y garantiza confidencialidad incluso durante el procesamiento.

Sin embargo, en la práctica presenta importantes limitaciones:

Altísimo coste computacional.

Dificultad para escalar a modelos complejos de IA.

Tiempo de entrenamiento y predicción muy lento.

Aplicabilidad limitada a escenarios de investigación o cálculo puntual.

Aunque es una herramienta prometedora en algunos contextos (por ejemplo, para consultas muy sensibles sobre datos cifrados), su uso en entrenamientos reales de modelos de IA sigue siendo muy restringido.

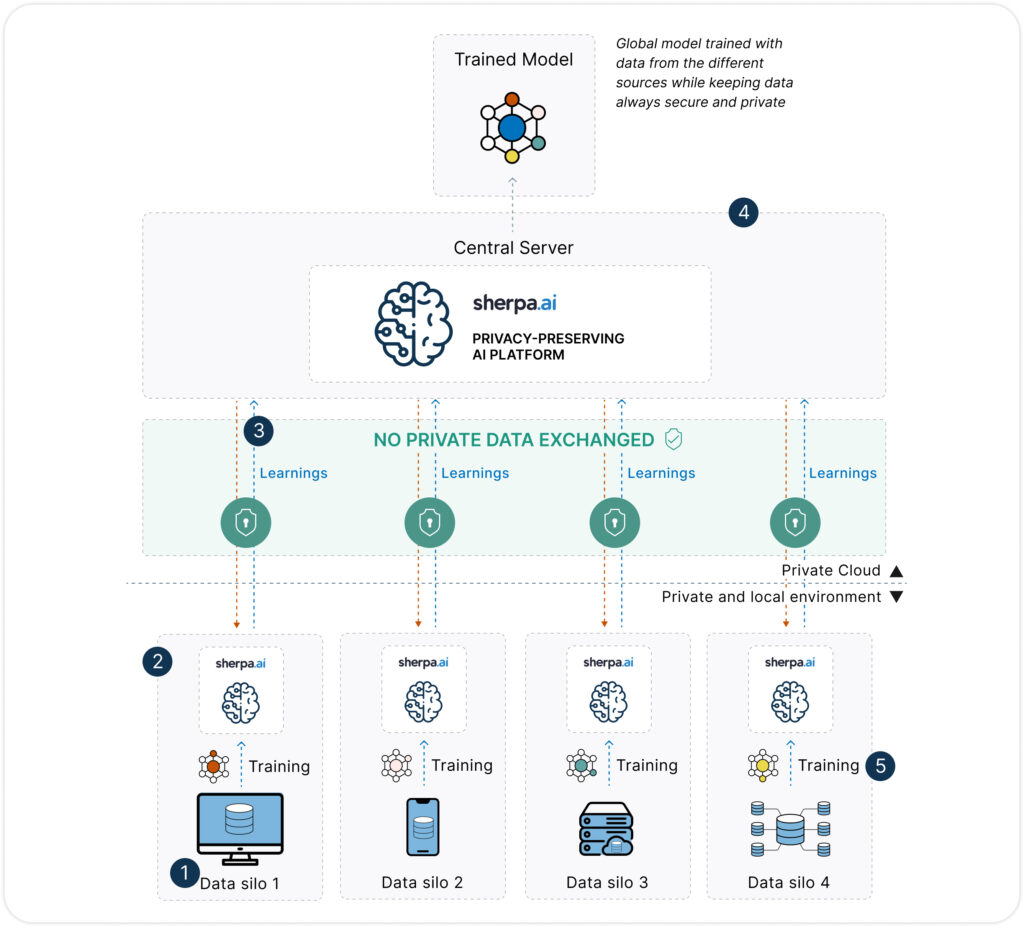

Una solución desde el diseño

A diferencia de los datos sintéticos, el Aprendizaje Federado propone un cambio radical: en lugar de mover los datos al modelo, mueve el modelo a los datos. Esto permite que cada organización o dispositivo entrene localmente una copia del modelo sobre sus propios datos, compartiendo únicamente actualizaciones del modelo (no los datos en sí).

Beneficios clave:

Privacidad real: los datos nunca abandonan su origen.

Cumplimiento por diseño con normativas de protección de datos.

Mayor fidelidad: se entrena directamente sobre los datos reales, sin necesidad de crear réplicas sintéticas.

Escalable y adaptable a múltiples entornos, incluyendo edge computing, dispositivos móviles, entornos hospitalarios, o plataformas soberanas de datos.

Si quieres saber más consulta aquí

Ventajas frente al cifrado homomórfico

| Categoría / Dimensión | Nuestra Plataforma | Cifrado Homomórfico |

|---|---|---|

| Privacidad | ||

| Privacidad de los datos | ✅ Alta: los datos nunca se comparten. Solo se intercambian actualizaciones del modelo. | ✅ Alta: los datos permanecen cifrados incluso durante el procesamiento. |

| Anonimización previa | ✅ No necesaria: el modelo se entrena directamente en origen sin acceso al dato. | ❌ Necesaria: los datos están cifrados, pero se requiere cifrado robusto y manejo de claves. |

| Cumplimiento normativo (GDPR, HIPAA…) | ✅ Sólido: se alinea con regulaciones al evitar la transferencia de datos personales. | ⚠️ Potencialmente sólido: depende de la correcta gestión de claves y del cifrado aplicado. |

| Gestión del dato | ✅ El dato permanece bajo control de la organización de origen. | ⚠️ El dato es opaco para el sistema, pero se pierde control operativo sobre su procesamiento cifrado. |

| Rendimiento | ||

| Transmisión de datos | ✅ No: los datos nunca abandonan su origen. | ⚠️ Limitada: los datos cifrados pueden moverse, aunque no son accesibles. |

| Consumo energético | ✅ Eficiente: el entrenamiento distribuido minimiza recursos innecesarios. | ❌ Muy alto: requiere gran capacidad de cómputo para operar sobre datos cifrados. |

| Tiempos de entrenamiento | ✅ Razonables: se entrena en paralelo y de forma local por nodos orquestados. | ⚠️ Muy lentos: las operaciones cifradas pueden ser miles de veces más costosas. |

| Calidad del modelo | ✅ Alta: se entrena sobre datos reales y actualizados. | ⚠️ Limitada: se restringe a modelos simples debido al coste computacional. |

| Escalabilidad | ||

| Coste de implementación | ✅ Bajo-moderado: no requiere duplicar datos ni infraestructura legal compleja. | ❌ Alto: necesita criptografía avanzada, potencia de cálculo y especialistas. |

| Escalabilidad | ✅ Alta: probado en entornos reales con miles de nodos (banca, salud, defensa…). | ⚠️ Limitada: difícil de aplicar a gran escala por las exigencias computacionales. |

| Integración con sistemas existentes | ✅ Flexible: API abierta, integración sencilla con infraestructura actual. | ⚠️ Compleja: necesita adaptaciones para operar cifrado a nivel de aplicación. |

| Gobernanza | ||

| Trazabilidad y auditoría | ✅ Alta: cada nodo gestiona sus datos y se pueden auditar contribuciones al modelo. | ⚠️ Difusa: difícil auditar el proceso sobre datos cifrados o su vinculación con fuentes originales. |

| Control de los participantes | ✅ Total: cada entidad mantiene el control de sus datos, nodos y políticas. | ⚠️ Parcial: depende del gestor de claves y del entorno de computación. |

Cumplimiento con GDPR y riesgos del cifrado homomórfico

Uno de los principales objetivos del uso de tecnologías como el Cifrado Homomórfico es cumplir con las normativas de privacidad, especialmente el Reglamento General de Protección de Datos (RGPD) en Europa. Sin embargo, el grado de cumplimiento y los riesgos asociados varían significativamente entre ambas tecnologías.

Cumplimiento sólido y verificable

El enfoque nuestra plataforma se alinea de forma natural con los principios del GDPR:

Minimización de datos: al no mover los datos del origen, se evita su exposición innecesaria.

Limitación de la finalidad: los datos se usan solo para un fin concreto y en su entorno controlado.

Responsabilidad y trazabilidad: cada organización mantiene el control sobre sus datos y nodos.

Privacidad desde el diseño (Privacy by Design): el sistema está construido para no necesitar el acceso directo al dato.

Esta aproximación reduce significativamente los riesgos legales y facilita la implementación de auditorías y evaluaciones de impacto (DPIA).

Cifrado Homomórfico: protección fuerte, pero con nuevas incertidumbres

Aunque el cifrado homomórfico garantiza una confidencialidad total del contenido durante el procesamiento, no elimina por completo el riesgo desde el punto de vista regulatorio:

La gestión de claves criptográficas se convierte en un nuevo vector crítico: si la clave privada se ve comprometida, todos los datos cifrados pueden quedar expuestos.

El tratamiento automatizado de datos personales cifrados sigue siendo procesamiento a efectos de la RGPD, incluso si los datos no son legibles por humanos.

Dificultad para realizar auditorías: es complejo demostrar cómo se ha procesado una información cifrada sin acceder al contenido descifrado.

Riesgo de reidentificación: si los datos cifrados se descifran fuera del entorno controlado, se reactivan los riesgos originales de privacidad.

Además, el uso exclusivo de cifrado no garantiza el cumplimiento de principios como la minimización o la gobernanza distribuida, que sí están mejor cubiertos por el Aprendizaje Federado.

Aprendizaje Federado ¿Por qué es más adecuado qué el cifrado homomórfico?

Aunque tanto el Aprendizaje Federado como el Cifrado Homomórfico comparten el objetivo de proteger la privacidad de los datos, solo el Aprendizaje Federado ofrece una solución práctica, escalable y ya madura para el mundo real.

1. Listo para producción, hoy

A diferencia del cifrado homomórfico —aún limitado por su coste computacional y complejidad técnica—, ya está siendo utilizado en proyectos reales en sectores como salud, banca, movilidad o defensa. La plataforma de Sherpa.ai, por ejemplo, ha sido desplegada con éxito en entornos complejos, orquestando miles de nodos de entrenamiento con cumplimiento normativo y eficiencia operativa.

2. Privacidad sin sacrificar rendimiento

Permite entrenar modelos con datos reales, actuales y completos —sin mover ni duplicar información sensible—. Esto garantiza una calidad de modelo muy superior a la que se puede obtener hoy mediante técnicas puramente criptográficas, sin renunciar a la protección de la privacidad.

3. Cumple con las normativas de forma natural

Al mantener los datos siempre bajo el control de su propietario y evitar su transferencia, encaja perfectamente con principios regulatorios como los de la RGPD o HIPAA. Además, permite aplicar técnicas adicionales como differential privacy, secure aggregation o incluso cifrado parcial para maximizar la protección.

4. Escalable, flexible y adaptable

Desde dispositivos móviles hasta hospitales o sistemas de defensa, se adapta a distintos entornos sin necesidad de rediseñar la infraestructura ni exponer los datos. Sherpa.ai ofrece una plataforma versátil, con APIs abiertas, despliegue en nube, edge u on-premise, y una interfaz pensada para integrarse con facilidad en cualquier flujo de trabajo

Sherpa.ai: la plataforma más avanzada del mercado

En este contexto, nuestra plataforma de IA es más potente y completa de Europa, diseñada específicamente para resolver los retos de privacidad, seguridad y cumplimiento normativo en los sectores más exigentes.

¿Qué hace única a nuestra plataforma?

Privacidad diferencial integrada: no solo se entrena sin compartir datos, sino que además se aplican perturbaciones matemáticas para evitar la reconstrucción del dato a partir de los parámetros del modelo.

Control total por parte del cliente: los datos nunca salen del entorno del cliente. La plataforma puede desplegarse en sus instalaciones o en nube privada, garantizando la soberanía del dato.

Auditoría y trazabilidad: la solución incluye herramientas para registrar y demostrar que se cumple con la RGPD, la Ley de IA de la UE y otras normativas sectoriales.

Alta interoperabilidad y rendimiento: compatible con distintos frameworks de IA (TensorFlow, PyTorch, etc.), orquestación avanzada de nodos y comunicación eficiente.

Casos reales en producción: Sherpa.ai ya trabaja con bancos, hospitales, Telcos y organismos públicos que están usando IA Federada para extraer valor del dato sin comprometer la privacidad.

En un mundo cada vez más regulado y consciente de la importancia de la privacidad, entrenar modelos de inteligencia artificial sin comprometer los datos se ha convertido en un desafío estratégico. Tanto el Aprendizaje Federado como el Cifrado Homomórfico ofrecen soluciones innovadoras, pero muy distintas en su enfoque y aplicabilidad.

Mientras que el cifrado homomórfico plantea una solución teóricamente segura, su alto coste computacional y su baja madurez tecnológica lo hacen poco viable en muchos contextos reales. Por el contrario, el Aprendizaje Federado ha demostrado ser una alternativa práctica, escalable y alineada con los marcos regulatorios más exigentes.

Con la capacidad de entrenar modelos de IA directamente donde residen los datos, sin exponerlos ni moverlos, permite a organizaciones públicas y privadas extraer valor de la información de forma ética, segura y eficiente.

En Sherpa.ai estamos liderando esta transformación, ofreciendo una tecnología que no solo protege la privacidad, sino que impulsa una inteligencia artificial más responsable, interoperable y preparada para el futuro.